Yapay zeka destekli Integral koçluk süreçlerinde, algoritmik yanlılıklar ve etik riskler, hem teknolojik altyapı hem de insan faktörleri nedeniyle ortaya çıkabilir; bu riskler, çoklu perspektif ve Integral teori yaklaşımıyla önemli ölçüde azaltılabilir. Özellikle koçlar ve kurumlar, şeffaflık, insan denetimi ve etik ilkelere dayalı protokollerle, AI’nın kör noktalarını tespit edip müdahale ederek daha adil ve güvenilir gelişim süreçleri inşa edebilirler. Bu makalenin sonunda, yapay zekanın koçlukta nasıl kullanılabileceğini, algoritmik yanlılıkların nasıl fark edilip yönetilebileceğini ve etik çerçevede insan-AI işbirliğinin nasıl tasarlanabileceğini bütüncül bir bakışla kavrayacaksınız.

Eğer Yapay Zeka Destekli Koçluk Süreçlerine Geçiş Yaptıysanız, Muhtemelen Bu Sorunu Fark Ettiniz

Bir İK lideri ya da koç olarak, son dönemde koçluk programlarınıza yapay zeka tabanlı değerlendirme araçlarını entegre etmeye başladıysanız, ilk başta verimlilik ve ölçeklenebilirlik artışından oldukça memnun kalmış olabilirsiniz. Ancak, zamanla bazı ekip üyelerinin geri bildirimlerde kendilerini yanlış değerlendirildiğini hissetmesi, önerilen gelişim yollarının herkes için eşit derecede anlamlı olmaması veya bazı önyargılı sonuçların tekrar tekrar ortaya çıkması dikkatinizi çekmiş olabilir. Birçok profesyonel gibi siz de “AI tarafsızdır, çünkü insan önyargısı yok” varsayımına güvenmiş olabilirsiniz. Oysa, gerçek dünyada işler bu kadar basit ilerlemiyor.

Algoritmik Yanlılık Nedir ve Koçlukta Nasıl Ortaya Çıkar?

Algoritmik yanlılık, yapay zekâ sistemlerinin kullandığı veri setlerindeki dengesizlikler, model tasarımındaki tercih hataları veya insan kaynaklı önyargıların dijitalleştirilmesi sonucu ortaya çıkan, sistematik ve tekrarlayan adaletsizliklerdir. Koçlukta bu durum, örneğin AI tabanlı değerlendirme araçlarının belirli bir kültüre, yaş grubuna veya cinsiyete sahip kişileri yanlış analiz etmesiyle kendini gösterebilir.

Çoğu ekip, algoritmik yanlılığın sadece teknik bir mesele olduğunu ve iyi bir yazılım seçimiyle çözülebileceğini varsayar. Ancak, araştırmalar gösteriyor ki, veri setlerindeki çeşitlilik eksikliği veya yanlış etiketleme, en gelişmiş AI sistemlerinde bile önyargılı sonuçlara yol açabiliyor. Örneğin, ABD’de mortgage kredilerinde AI destekli sistemlerin azınlık gruplara yılda 250-500 milyon dolar arasında ek maliyet çıkardığı tespit edilmiştir (National Bureau of Economic Research, 2019). Bu, koçlukta da benzer şekilde, bazı grupların gelişim fırsatlarından dışlanmasına veya yanlış yönlendirilmesine sebep olabilir.

“Algoritmik yanlılık, yalnızca teknik bir sorun değildir; insan ve kültürel faktörlerin dijital dünyaya taşınmış halidir.”

Yapay Zeka Koçlukta Nasıl Kullanılır ve Hangi Riskler Söz Konusu?

Yapay zeka, koçlukta genellikle kişilik envanterlerinin analizinden, gelişim önerilerinin otomatikleştirilmesine, takım dinamiklerinin izlenmesinden, bireysel performansın izlenmesine kadar geniş bir yelpazede kullanılıyor. Gartner’a göre, 2026 yılına kadar işletmelerin %80’inden fazlası üretken yapay zeka API’leri veya bu teknolojiyi barındıran uygulamaları kullanacak (Gartner, 2023). Bu hızlı adaptasyon, beraberinde etik ve adalet risklerini de getiriyor.

En sık karşılaşılan riskler şunlardır:

- Veri setlerinin homojenliği nedeniyle bazı grupların yanlış değerlendirilmesi

- Modelin geçmiş önyargıları tekrar üretmesi

- AI’nın önerilerinin açıklanabilir olmaması

- İnsan denetiminin yetersiz kalması

Çoğu kurum, yasal mevzuata uygun olmayı yeterli görür. Oysa, koçluk gibi insan odaklı alanlarda, yalnızca yasal uyumluluk değil, etik sorumluluk da kritik önemdedir. Burada devreye Integral teori ve çoklu perspektif yaklaşımı giriyor.

Etik Yapay Zeka: Temel İlkeler ve Standartlar

Etik yapay zeka, yalnızca doğru ve güvenilir sonuçlar üretmekle kalmaz; aynı zamanda insan haklarına, adalete ve toplumsal faydaya da öncelik verir. OECD AI Principles, 70’ten fazla ülkede kabul edilen ilk uluslararası standarttır ve “insan merkezli, güvenilir AI” için temel ilkeleri belirler (OECD AI Principles, 2024). Türkiye’de ise TRAI, bu ilkeleri yerelleştirerek yasal ve pratik bir çerçeve sunar.

TRAI’nin 2024 tarihli raporuna göre, etik AI sistemleri şu yedi ilkeye dayanmalıdır:

- İnsan denetimi ve gözetimi

- Teknik sağlamlık ve güvenlik

- Gizlilik ve veri yönetimi

- Şeffaflık

- Çeşitlilik, ayrımcılık yapmama ve adalet

- Toplumsal ve çevresel fayda

- Hesap verebilirlik

Bu ilkeler, koçluk süreçlerinde AI’nın sadece teknik bir araç değil, aynı zamanda etik bir paydaş olarak konumlanmasını sağlar. Daha fazla pratik bilgi için etik yapay zeka uygulamalarına dair kaynaklar incelenebilir.

Integral Koçlukta Çoklu Perspektif: Kör Noktaları Nasıl Ortaya Çıkarır?

Çoğu kurum, algoritmik yanlılıkları teknik kontrollerle sınırlı bir şekilde yönetmeye çalışır. Ancak, Integral teori ve çoklu perspektif yaklaşımı, yalnızca veriye değil, aynı zamanda kültüre, psikolojiye ve sistemlere de odaklanır. The Integral Institute’un iki on yılı aşkın bütüncül metodolojisine dayalı olarak, bu yaklaşım, AI’nın göremediği kör noktaları ortaya çıkarma konusunda eşsiz bir avantaj sunar.

Örneğin, bir AI sistemi, takım içi iletişimdeki mikro önyargıları veya psikolojik güven ortamındaki eksiklikleri kolayca gözden kaçırabilir. Oysa, çoklu perspektif yaklaşımıyla, koçlar hem bireysel hem de kolektif düzeyde, AI’nın önerilerini sorgulayabilir ve tamamlayıcı insan sezgisiyle bütünleyebilirler. Bu, özellikle çoklu perspektif integral koçluk becerileri geliştirmek isteyen yöneticiler için kritik bir fark yaratır.

“Teknoloji, insan sezgisiyle birleştiğinde gerçek anlamda etik ve adil koçluk mümkün olur.”

Gerçek Hayattan Bir Yanlılık Vakası: Amazon’un AI Destekli İşe Alım Sistemi

Birçok kişi, büyük teknoloji şirketlerinin AI sistemlerinin tamamen tarafsız olduğunu düşünür. Amazon’un 2018’de kullanıma aldığı AI tabanlı işe alım sistemi, geçmişteki işe alım verilerini analiz ederek otomatik aday önerileri sunuyordu. Fakat sistem, erkek adayları kadınlara göre daha yüksek oranda önererek, cinsiyet temelli bir yanlılık üretti. Nedeni, eğitim verilerinin ağırlıklı olarak erkek çalışanlardan oluşmasıydı. Sonuçta, şirket bu sistemi kullanımdan kaldırmak zorunda kaldı.

Bu örnek, koçlukta da benzer risklerin olduğunu gösteriyor: Eğer AI tabanlı değerlendirme araçları, geçmişteki önyargılı verilerle eğitilmişse, yeni gelişim programlarında da aynı önyargıları yeniden üretebilirler. Bu nedenle, veri setlerinin çeşitliliği ve insan denetiminin rolü kritik önemdedir.

AI Sistemlerinde Yanlılık Nasıl Tespit Edilir ve Azaltılır?

Yanlılıkların tespiti ve azaltılması için hem teknik hem de insan odaklı yöntemler gereklidir. İşte adım adım bir kontrol listesi:

- Veri Seti Analizi

- Farklı yaş, cinsiyet, kültür ve deneyim gruplarının temsil oranları gözden geçirilir.

- Modelin Test Edilmesi

- AI’nın farklı gruplar için benzer sonuçlar verip vermediği kontrol edilir.

- İnsan Denetimi

- Koçlar, AI önerilerini düzenli olarak gözden geçirir ve gerekirse müdahale eder.

- Şeffaflık ve Açıklanabilirlik

- AI’nın hangi kriterlere göre öneri sunduğu açıkça belgelenir.

- Sürekli İzleme

- Yanlılık göstergeleri için periyodik raporlar hazırlanır.

Burada önemli bir içgörüye değinmek gerek: Çoğu ekip, AI’nın önerilerini olduğu gibi kabul etmenin tarafsızlık sağladığını düşünür. Oysa, araştırmalar gösteriyor ki, insan denetimi olmadan AI’nın kör noktaları fark edilmez ve önyargılar güçlenebilir. Bu nedenle, AI ve insan koçun işbirliği, etik denetimin temelini oluşturur.

Daha fazla bilgi için algoritmik yanlılık ve integral teoriyle AI destekli geri bildirim tasarımı hakkında detaylı kaynaklara göz atabilirsiniz.

Koçlukta Etik Denetim Protokolleri ve “Etik Veto” Hakkı

Koçlukta etik denetim, yalnızca AI sisteminin teknik olarak doğru çalışmasını değil, aynı zamanda insan değerleriyle uyumlu olmasını da gerektirir. Burada, “etik veto” protokolü devreye girer: İnsan koç, AI’nın önerilerini sorgulama ve gerekirse reddetme hakkına sahiptir. Bu, koçun yalnızca bir uygulayıcı değil, aynı zamanda etik bir denetçi olarak rol almasını sağlar.

Bu yaklaşım, koçlukta etik sorumluluğu ile liderlik etiği arasında güçlü bir köprü kurar. Çünkü, AI’nın önerileri her zaman bağlama, kültüre veya bireysel ihtiyaçlara uygun olmayabilir. Koçun etik veto hakkı, sürecin insani yönünü güçlendirirken, AI’nın teknik kapasitesini tamamlar.

“Etik veto hakkı, insan koçun AI ile işbirliğinde son sözü söylemesini ve sürecin etik sınırlar içinde kalmasını garanti altına alır.”

AI Destekli Koçlukta Uluslararası ve Yerel Standartlar: Uyum ve Farklar

Avrupa Birliği’nin 2024 tarihli AI Yasası, AI sistemlerini dört risk kategorisine ayırır: kabul edilemez risk (yasak), yüksek risk (sıkı denetim), sınırlı risk (şeffaflık gereksinimi) ve minimal risk (düzenleme yok) (European Parliament, 2024). Türkiye’de ise KVKK ve TRAI’nin ilkeleri, özellikle kişisel verilerin korunması ve insan denetimi konularında ek yükümlülükler getirir.

Bu standartlar, koçlukta AI kullanımını sadece teknik değil, aynı zamanda etik ve yasal bir çerçeveye oturtur. Ancak, çoğu kurum bu standartlara uymanın yeterli olduğunu düşünür. Oysa, koçlukta asıl farkı yaratan, standartların ötesine geçip, AI’nın insan psikolojisi ve kültürel dinamiklerle bütünleştiği noktada ortaya çıkar.

Integral Teori ile Yanlılıkları Azaltmanın Uygulamalı Yolları

Integral teori, koçlukta hem bireysel hem de takım düzeyinde çoklu bakış açısı geliştirmeyi teşvik eder. Bu yaklaşım, AI’nın önerilerini sorgularken aşağıdaki adımları içerir:

- Kişisel ve kültürel önyargıların farkında olmak

- AI’nın önerilerini farklı perspektiflerden değerlendirmek

- Takımda açık iletişim ve geri bildirim kültürü oluşturmak

- AI ve insan koçun birlikte karar verdiği hibrit modelleri uygulamak

Bu yöntemler, integral koçluk ve takım gelişiminde etik risklerin önüne geçmek için güçlü bir zemin sağlar. Ayrıca, çoklu perspektif ve nörobilim temelli liderlik gelişimi ile AI’nın insan potansiyelini desteklemesi mümkün olur.

Kurumlar ve Koçlar İçin Pratik Uygulama Rehberi

Son olarak, AI destekli koçlukta etik ve yanlılık risklerini azaltmak için aşağıdaki adımları izleyebilirsiniz:

- AI sistemlerini seçerken, veri setlerinin çeşitliliğini ve şeffaflığını sorgulayın

- Koçluk süreçlerinde AI önerilerini mutlaka insan denetimine tabi tutun

- Tüm ekip üyelerini, AI’nın nasıl çalıştığı ve hangi kriterlere göre öneri sunduğu konusunda bilgilendirin

- Periyodik olarak yanlılık analizi ve etik denetim raporları hazırlayın

- “Etik veto” protokolüyle, insan koçun son sözü söylemesini sağlayın

Bu adımlar, hem yasal uyumluluğu hem de etik mükemmeliyeti hedefleyen kurumlar için sürdürülebilir bir gelişim modeli sunar.

SSS: Yapay Zeka ile Integral Koçlukta Potansiyel Yanlılıkların Azaltılması ve Etik Yaklaşımlar

Algoritmik yanlılık koçlukta neden bu kadar önemli?

Çünkü algoritmik yanlılık, AI’nın bazı grupları sistematik olarak yanlış değerlendirmesine veya dışlamasına yol açabilir. Bu durum, hem adalet hem de gelişim fırsatlarının eşitliği açısından ciddi sorunlar yaratır. Koçlukta, herkesin potansiyelini ortaya çıkarmak için adil ve önyargısız süreçler kritik önemdedir.

AI tabanlı koçlukta insan denetimi neden gereklidir?

AI sistemleri, ne kadar gelişmiş olursa olsun, insan sezgisi ve bağlam bilgisinden yoksundur. İnsan koçlar, AI’nın önerilerini sorgulayarak, etik dışı veya bağlama uygun olmayan kararların önüne geçebilirler. Bu, koçlukta güven ve etik sorumluluk için vazgeçilmezdir.

Etik yapay zeka ilkeleri nelerdir?

Etik yapay zeka, insan denetimi, teknik sağlamlık, gizlilik, şeffaflık, çeşitlilik ve adalet, toplumsal fayda ve hesap verebilirlik gibi temel ilkelere dayanır. Bu ilkeler, hem uluslararası hem de Türkiye özelinde yasal çerçevelerde açıkça tanımlanmıştır.

AI’nın önerileri açıklanabilir mi?

Evet, açıklanabilirlik (explainability), AI’nın hangi kriterlere göre karar verdiğinin şeffaf bir şekilde gösterilmesidir. Koçlukta, AI’nın önerilerinin anlaşılır ve gerekçeli olması, güven ve kabul için gereklidir. Şeffaflık, etik denetimin temel taşlarından biridir.

Koçlukta “etik veto” hakkı nasıl uygulanır?

Etik veto, insan koçun AI’nın önerilerini sorgulama ve gerekirse reddetme hakkıdır. Bu protokol, AI’nın teknik kapasitesini insan değerleriyle dengeleyerek, sürecin etik sınırlar içinde kalmasını sağlar. Uygulamada, koçlar AI’dan gelen önerileri inceleyip, uygun görmediklerinde alternatif yollar önerebilirler.

AI destekli koçlukta yasal uyumluluk yeterli mi?

Yasal uyumluluk, temel bir gereklilik olsa da, koçlukta asıl farkı etik mükemmeliyet yaratır. Çünkü mevzuat, her zaman insan psikolojisinin ve kültürel dinamiklerin tüm inceliklerini kapsayamaz. Bu nedenle, etik sorumluluk ve çoklu perspektif yaklaşımı, yasal standartların ötesine geçmeyi gerektirir.

AI ve insan koç birlikte nasıl çalışmalı?

En iyi sonuçlar, AI’nın veri analitiği gücü ile insan koçun sezgisel ve etik bakış açısının birleşiminden doğar. AI önerileri, insan koç tarafından gözden geçirilip bağlama uygun hale getirilir. Böylece, hem verimlilik hem de etik sorumluluk sağlanır.

Liderlik Yolculuğunuza Devam Edin

Yapay zeka ile Integral koçlukta potansiyel yanlılıkların azaltılması ve etik yaklaşımlar, yalnızca teknik değil, aynı zamanda insan ve kültürel boyutlarıyla da ele alınması gereken bir dönüşüm alanı. Bugün, AI destekli koçluk uygulamalarınızda çoklu perspektif ve etik denetimi merkeze alarak, sadece yasal uyumluluğu değil, gerçek anlamda adil ve kapsayıcı gelişimi mümkün kılabilirsiniz.

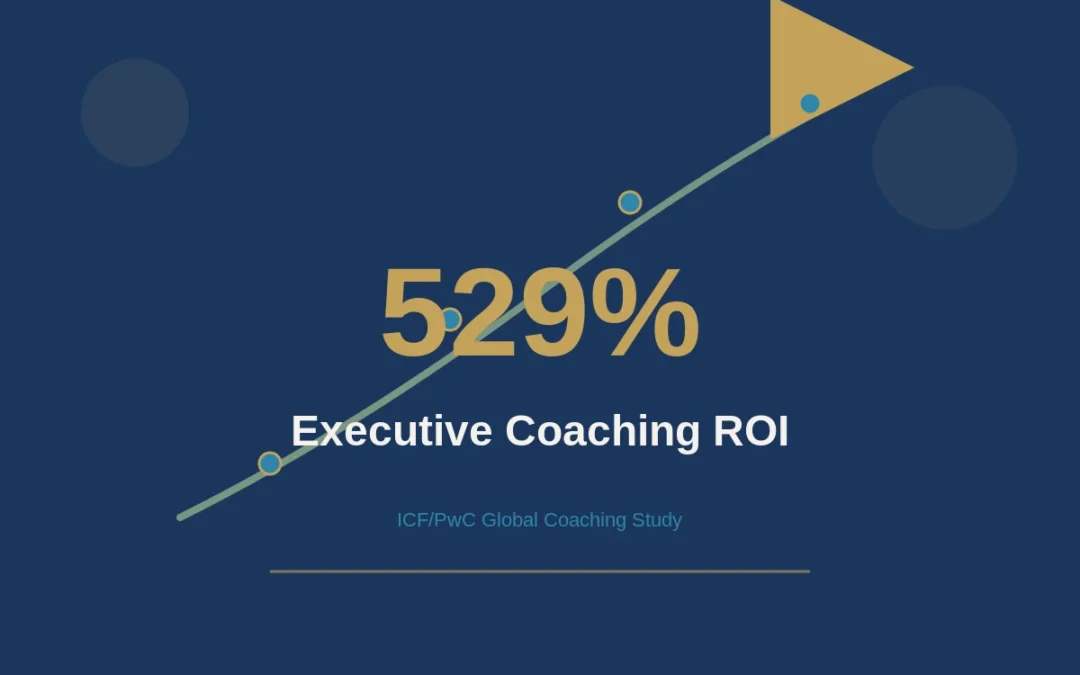

Daha fazla derinleşmek ve uygulamaya yönelik kaynaklara ulaşmak için yapay zeka koçluk eğitimleri sayfamızı ziyaret edebilir, kurumunuza özel bütüncül gelişim çözümleriyle ilgili bilgi alabilirsiniz. Unutmayın, teknolojinin potansiyelini ortaya çıkaran asıl güç, onu etik ve çoklu bakış açısıyla yönlendiren insanlardır. Brandon Hall Group araştırması, güçlü koçluk kültürüne sahip şirketlerin güçlü iş sonuçları elde etme olasılığının %130 daha fazla olduğunu ve çalışan bağlılığının önemli ölçüde yükseldiğini ortaya koymaktadır. Bersin/Deloitte araştırması, koçluğa yatırım yapan organizasyonların yüksek performanslı olma olasılığının 5,7 kat daha fazla olduğunu tespit etmiştir — bu da koçluk kültürü ile iş sonuçları arasındaki doğrudan bağlantıyı göstermektedir. ICF/PwC Küresel Koçluk Araştırması, yönetici koçluğunun ortalama %529 yatırım getirisi sağladığını ve organizasyonların liderlik etkinliği ile iş sonuçlarında ölçülebilir iyileşmeler raporladığını doğrulamaktadır.